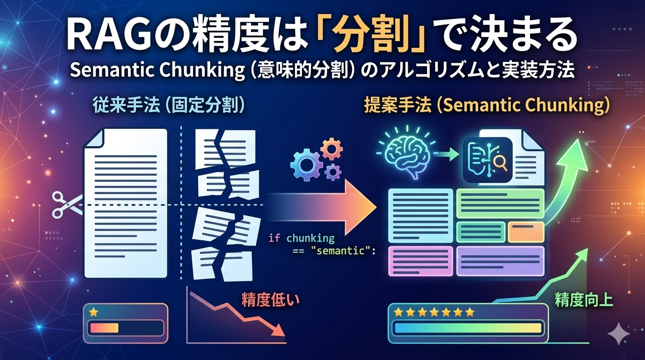

RAGの精度は「分割」で決まる:Semantic Chunking(意味的分割)のアルゴリズムと実装方法

ChatGPTをはじめとするLLM(大規模言語モデル)をビジネス実装する際、デファクトスタンダードとなっているのがRAG(Retrieval-Augmented Generation)です。

しかし、多くの企業が「導入したものの回答が的外れ」「文脈が支離滅裂」といった精度面の課題に直面しています。

その主要な原因は、ドキュメントをAIが読みやすいサイズに切り分ける「チャンク分割(Chunking)」の工程にあります。従来の機械的な分割では、文章の途中で意味が分断され、検索時に必要なコンテキストが欠落してしまうのです。

本記事では、RAGの精度を劇的に向上させる最新手法「Semantic Chunking(意味的分割)」を徹底解説します。

従来手法の限界とSemantic Chunkingのメリット

ここでは、以下の点について解説します。

- 固定長分割と再帰的分割の限界

- 意味の境界線を特定するSemantic Chunking

- 検索適合率の向上

固定長分割と再帰的分割の限界

初期のRAGで主流だった「固定長分割(Fixed-size Chunking)」は、指定した文字数で機械的に区切る手法です。

また、句読点を考慮する「再帰的分割」も広く使われていますが、依然として「トピックの区切り」を正確に判別することは困難です。

これらの手法では、重要な一文が2つのチャンクに跨ってしまい、ベクトル検索の際に類似度が低下したり、LLMが不完全な情報を元に回答を生成したりするリスク(Context Fragmentation)が常につきまといます。

特に専門用語や複雑な構文が多いビジネス文書において、この「意味の断絶」は致命的なハルシネーション(もっともらしい嘘)を誘発する要因となります。

意味の境界線を特定するSemantic Chunking

Semantic Chunkingは、テキストの「意味的な変化」を検出し、文脈が切り替わるポイントで自動的に分割する高度なアプローチです。

単なる文字数ではなく、文章間の「ベクトル距離」を計算することで、トピックが変化した瞬間に境界線を引きます。

これにより、1つのチャンクが1つの完結した意味を持つようになり、AIにとって極めて理解しやすいデータ構造が完成します。固定長分割とは異なり、文章の途中で情報が途切れることがないため、検索段階での情報の欠落を根本から防ぐことが可能です。

検索適合率の向上

意味的に整合性の取れたチャンクは、ユーザーの質問に対する「検索のヒット率」を飛躍的に高めます。

例えば、複雑な業務マニュアルから特定の規定を探し出す際、関連する条件がひとまとめに取得されるため、回答の正確性が向上し、社内ヘルプデスクの工数削減や顧客満足度の向上に直結します。

精度の高いRAGは、単なる情報検索ツールではなく、企業の意思決定を支える「信頼できるナレッジエンジン」としての価値を持つようになるでしょう。

Semantic Chunkingのアルゴリズムと実装のポイント

ここでは、以下の点について解説します。

- ベクトル距離に基づく境界検出のプロセス

- 精度を左右する閾値(Threshold)のチューニング

- 実装ツールとライブラリの選定

ベクトル距離に基づく境界検出のプロセス

Semantic Chunkingの核心は、隣接する文章間の「意味の近さ」を数値化することにあります。

具体的なプロセスとしては、まず入力テキストを個別の文(Sentence)に分解します。次に、文脈を保持するために前後の文を一定数まとめた「バッファ」を作成し、これらをEmbeddingモデル(OpenAIのtext-embedding-3-smallなど)で多次元ベクトルへと変換可能です。

その後、隣接するグループ間のコサイン類似度を算出し、その類似度が急激に低下した箇所を「意味の転換点」と判定して分割を行います。この動的な分割プロセスにより、ドキュメントごとの論理構造に最適化されたチャンクが生成されます。

精度を左右する閾値(Threshold)のチューニング

「どこで分割するか」を決める閾値の設定は、RAGの性能を左右するエンジニアリングの肝です。

一般的には、全体の距離分布から乖離が大きい上位数%を分割点とする「パーセンタイル方式」や、平均的な距離から一定以上離れた場合に分割する「標準偏差方式」が用いられます。

ドキュメントの性質が、論理構成が明確な技術書なのか、あるいは箇条書きが多い議事録なのかによって、最適な閾値は大きく異なります。

実務においては、開発環境でのプロンプトエンジニアリングと同様に、分割精度の評価指標を定め、継続的にパラメータをチューニングする「評価フェーズ」の構築が不可欠です。

実装ツールとライブラリの選定

現代のAI開発では、LangChainやLlamaIndexが提供するSemanticChunkerクラスを活用するのが効率的です。

これらのライブラリは、複雑なベクトル計算ロジックをラップしており、エンジニアは埋め込みモデルの選択と閾値の指定に集中できます。

ただし、エンタープライズ環境の実装においては、APIコストの最適化やリアルタイム性を考慮し、商用モデルだけでなく、ローカルで動作する軽量なオープンソースモデル(BGE-m3など)を検討する設計判断も求められます。

システム全体のレイテンシとコスト、精度のトレードオフを見極めることが、プロフェッショナルな実装には欠かせません。

エンタープライズRAGに求められる運用とガバナンス

ここでは、以下の点について解説します。

- メタデータ付与によるトレーサビリティの確保

- データ更新時の整合性を保つインデックス管理

- セキュリティとデータプライバシーへの対応

メタデータ付与によるトレーサビリティの確保

Semantic Chunkingで分割された各チャンクには、必ず「出典(ファイル名、ページ番号)」や「最終更新日」などのメタデータを付与すべきです。

RAGが生成した回答に対し、ユーザーが「どの資料に基づいているか」を即座に確認できる仕組みは、ビジネス現場での信頼獲得に直結します。

メタデータを充実させることで、LLMが回答の根拠を明示できるようになり、ビジネスの現場で最も懸念されるハルシネーション(根拠のない回答)のリスクを最小化し、業務利用に耐えうる透明性を確保できます。

データ更新時の整合性を保つインデックス管理

ドキュメントは日々更新されるため、一度設定した分割ロジックが常に最適であるとは限りません。

新規データの投入時に分割が意図せず細分化されすぎていないか、あるいは粗すぎていないかを監視する必要があります。RAGAS (RAG Assessment) などの評価フレームワークを導入し、「検索の正確性」や「回答の忠実性」を定期的にスコアリングする運用体制を構築することが、長期間にわたってAIシステムの信頼性を維持するための重要な要件となります。

セキュリティとデータプライバシーへの対応

セマンティックな解析を行う過程で、社内の機密情報が外部のEmbedding APIに送信されるケースがあります。

エンタープライズ実装においては、VPC(仮想プライベートクラウド)内でのモデル展開や、Azure OpenAI Service等の閉域網対応、さらには個人情報(PII)の自動検知・マスキング処理をデータパイプラインに組み込むことが必須です。

技術的な精度向上だけでなく、コンプライアンスを遵守したデータ処理設計が、最終的な導入の成否を分けることになります。

まとめ

RAGシステムの真の価値は、LLMの性能以上に、いかに「整理されたデータ」をAIに与えられるかにかかっています。

本記事で解説したSemantic Chunkingは、データの意味を構造的に理解させ、ビジネスで通用する精度の高い回答を引き出すための最重要技術の一つです。

技術的な課題解決や、戦略的なRAG構築に関する具体的な検討が必要な際は、ぜひ専門的な知見を持つパートナーにご相談ください。