Latest posts

Tag

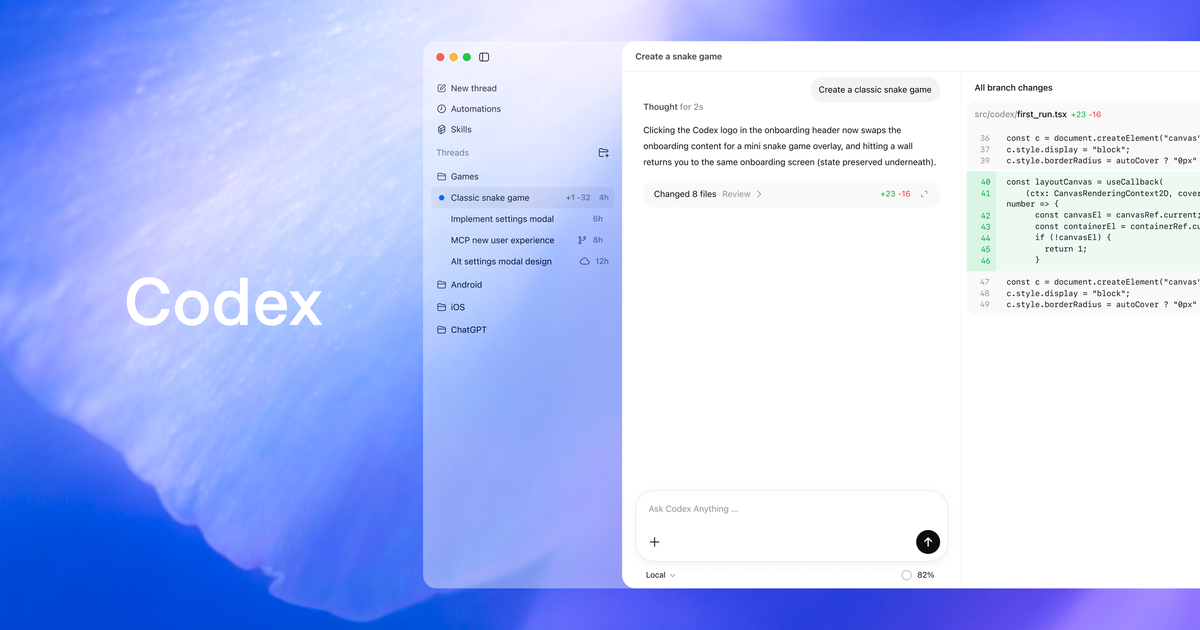

OpenAIのCodex専用席はなぜ“全員配布”に向かないのか──開発組織で利用者を絞るほど費用対効果が見えやすい理由

OpenAIのCodex専用席は、なぜ全員一律導入だと効果が見えにくいのか

AI開発支援ツールを導入するとき、最初に起きやすいのは「便利そうだから全員に広く導入しよう」という判断です。ですが、CodexのようなAI開発支援ツールは、誰に配るべきかを見極め、使う人と使い方を絞ったほうが、むしろ効果を測りやすくなります。

特に、エンジニア全員へのAI配布を検討しつつ予算配分に悩むCTOや開発部長にとっては、一律導入よりも、利用者を絞ったほうが費用対効果の判断材料を集めやすいはずです。

一律導入にすると、よく使う人とほとんど使わない人が同じ集計に混ざりやすくなります。その結果、評価設計を工夫しないと、導入効果が平均値に埋もれやすくなり、費用対効果も見えにくくなることがあります。

OpenAIの開発者向け情報としては、Codexの案内が参考になります。

製品の位置づけは、OpenAIの公式ページでも確認できます。

「便利そうだから全員に広げる」が起きやすい背景

AIツールは期待値が高いため、導入判断が個人の好感触に引っぱられやすい傾向があります。コード生成、調査補助、テスト支援といった機能は、全員の生産性を一気に押し上げるように見えます。

ただ、実際の開発現場では業務の中身がかなり違います。新機能の実装が多い人、保守対応が中心の人、レビューや設計調整の比率が高い人では、AI支援の効き方は同じではありません。

ここで一律導入をすると、「よく使う人」と「ほぼ使わない人」が混在します。すると、導入したツールの性能よりも、使われ方の偏りのほうが評価を左右する状態になります。

GitHub Copilotの調査や導入議論は、この論点を考える材料になります。

Codex活用の価値は、利用者と業務によって大きく変わる

Codex活用の価値は、利用者のスキルだけでなく、担当業務の性質でも変わります。既存コードを読みながら小さく直す仕事では、候補生成や説明補助が効きやすい一方で、要件調整や顧客折衝が多い役割では、活用価値は相対的に下がります。

つまり、同じAIツールでも「誰が使うか」で投資回収のスピードは変わります。毎日使う人には大きな価値がありますが、たまにしか使わない人まで広く導入しても、元を取りにくくなります。

さらに、生成AIの出力はそのまま採用できるとは限りません。レビュー、検証、修正の工程が必要であり、使う側に見極める力も求められます。

一般に、明確なドキュメントや信頼できるテスト環境があるほど、こうした開発支援ツールの効果を実務で引き出しやすいと考えられます。

Codexの初期の紹介ページは、製品の経緯を知る参考情報です。

https://openai.com/index/introducing-codex/

安全性や運用の考え方は、OpenAIの安全性ページも参考になります。

利用者を絞ると費用対効果が見えやすくなる3つの理由

第一に、比較対象を作りやすいことです。少人数に絞れば、導入チームと非導入チームで、作業時間、PR作成数、レビュー待ち時間などを比べやすくなります。全員一律導入だと、同時期の対照群を取りにくくなるため、導入前後比較や段階導入など、評価設計を工夫する必要が出てきます。

第二に、使い方の型が見えやすくなります。効果の高い人が、どの場面でAIを使っているかを観察しやすくなるからです。「テストケース作成には効くが、仕様が曖昧な実装には効きにくい」といった知見は、少人数導入のほうが拾いやすくなります。

第三に、継続判断がしやすいことです。3か月や6か月など期間を切り、対象者も限定すると、継続すべき対象と見直すべき対象を決めやすくなります。逆に全員に広く導入すると、「なんとなく使っている」状態が残りやすく、契約見直しの判断も甘くなりがちです。

生成AIの業務活用という観点では、Microsoft WorkLabの情報も参考になります。

開発生産性をどう捉えるかという点では、DORAの指標も土台になります。

優先導入しやすいのは、反復作業が多く成果を追いやすい高頻度利用者

優先導入の候補になりやすいのは、まず反復作業が多いエンジニアです。テスト補助、リファクタリング、定型コードの作成、既存コードの読解支援などでは、AIの恩恵を受けやすくなります。

次に、成果検証がしやすい人も向いています。チケット単位で作業量を追える人や、PRベースで改善を測れるチームに使ってもらうと、導入の妥当性を説明しやすくなります。

一方で、経験が浅すぎて出力の妥当性を判断しづらい人には、いきなり広く導入する必要はありません。初期導入では、「使いこなせる人」よりも「使って検証結果を返せる人」を選ぶほうが実務的です。

モデル利用時の検証やガードレールについては、OpenAIのドキュメントが参考になります。

https://platform.openai.com/docs

“使われない利用枠”が増えると、コスト以上に評価がぶれる

使われない利用枠が増えると、単にコストが無駄になるだけではありません。もっと厄介なのは、組織内の評価がぶれることです。

「便利だった」という人と「ほとんど使わなかった」という人が混ざると、ツール自体の評価なのか、対象者選定の失敗なのかが分かりにくくなります。結果として、次の投資判断も曖昧になります。

また、現場では学習コストも発生します。プロンプトの工夫、レビュー観点、社内ルールの理解など、活用には一定の慣れが必要です。

全員に広く導入しても、活用が浅いまま終わる人が多ければ、導入学習のコストだけが先に立ちます。セキュリティやガバナンスの面でも、初期導入では、利用範囲を絞ったほうが、権限管理や利用ルールの整備を進めやすい場合があります。

NISTのAIリスク管理フレームワークは、こうした段階的運用を考えるうえで参考になります。

少人数導入で見るべき指標は、利用実態と開発フローの改善

少人数導入でまず見るべきなのは、利用頻度です。週に何回使ったか、どの作業で使ったかを押さえるだけでも、利用実態は見えてきます。使用ログが取れるなら、定量データとして十分役立ちます。

次に見るべきは、時間短縮と待ち時間短縮です。実装そのものの速度だけでなく、調査にかかる時間、テストのたたき台作成、レビュー前の自己修正が短くなったかを確認します。

そのほか、PRあたりの修正往復回数、レビュー指摘の傾向、チケット完了までの日数も参考になります。重要なのは、AIを使ったかどうかではなく、チーム全体の流れが良くなったかを見ることです。

GitHubには、Copilotの効果測定に関する整理もあります。

開発者生産性の考え方を補助する材料として、Atlassianの情報も参照できます。

https://www.atlassian.com/blog/productivity

Codexの導入は、高頻度利用者への段階導入から始める

最終的には、「この役割には継続導入する」「この用途では優先度を下げる」といった判断につなげるのが理想です。全員一律導入を前提にするのではなく、まずは効果が出る場所を見つけるほうが、Codex活用の価値を組織として正しく評価できます。

AIツールは、導入しただけでは成果になりません。誰に持たせると最も効くかを見極めてこそ、投資として意味を持ちます。

検討段階では、高頻度利用者を先行対象にした段階導入方針を置き、対象業務と測定期間を決めたうえで判断材料を集める進め方が現実的です。

派手なAIニュースに流されず、導入対象の設計まで含めて考えることが、結果的にはいちばん堅実です。