Latest posts

Tag

NVIDIA NIMと企業向け推論基盤はなぜ再評価されるのか──モデル性能より“運用標準化”が選定軸になる背景

NVIDIA NIMと企業向け推論基盤が注目される背景

生成AIの企業導入では、以前のように「どのモデルが最も賢いか」だけで勝負が決まる段階を過ぎつつあります。いま現場で重視されているのは、複数モデルを企業内で安定運用できるか、さらに環境をまたいでも安定して動かし、更新し、監視できるかという運用面です。

この記事では、NVIDIA NIMがなぜ注目されているのかを、モデル性能ではなく運用標準化という観点から整理します。あわせて、生成AIの本番運用基盤を整えたいITインフラ責任者やMLOps担当者に向けて、企業向け推論基盤の選定で何が重視されやすくなっているのかを実務目線で見ていきます。

推論基盤の評価軸が性能比較から本番運用へ移った理由

結論から言うと、一部の企業では生成AI活用でPoC段階から本番段階への移行が進むケースが増えているためです。PoCでは精度や応答品質の比較が中心ですが、本番運用ではそれに加えて、可用性、コスト、権限管理、監査対応まで求められます。

たとえば、最初は一つの部門で試したAIチャットが、数か月後には複数部門へ広がることがあります。そのとき、モデルごとに配備方法や監視方法が違うと、運用負荷は一気に増えます。ここで重要になるのが、推論基盤をどう揃えるかです。

こうした議論はNVIDIAに限らず、他社の企業向けAI基盤でも見られます。企業向け生成AIの実装では、モデル単体よりも、MLOpsや推論の運用管理を含めた基盤整備が論点になっています。

NVIDIA NIMが注目されるのは“最強モデル”そのものだけが理由ではない

NIMは、特定の一つの最強モデルを売る製品ではありません。むしろ、さまざまなAIモデルを、企業環境で扱いやすい形の推論マイクロサービスとして提供する点に意味があります。

ポイントは、推論の呼び出し方、配備方法、最適化、運用の整え方をある程度そろえやすいことです。開発チームから見ればAPIとして扱いやすく、運用チームから見れば監視や更新の作法を統一しやすい、という価値があります。

つまり、NIMが注目される背景は、モデル性能の絶対値だけでは説明しきれません。企業が「本番で回る仕組み」を求めるなかで、標準化しやすい推論基盤の価値が相対的に意識されやすくなっていることは、一因として考えられます。

企業が本当に困るのはモデル選定後の運用ばらつき

企業のAI導入で見落とされやすいのは、モデル選定が終わった後の世界です。実務では、モデルそのものより、誰がどこで動かし、どう更新し、障害時にどう切り分けるかのほうが長く効いてきます。

たとえば、ある部署はクラウドAでAPI型LLMを使い、別部署はオンプレミスGPUで別モデルを動かし、さらに子会社は別のベンダー製推論サーバーを採用している、という状況は珍しくありません。こうなると、ログの形式、認証方式、性能監視、セキュリティルールがそろわず、全社最適が難しくなります。

この「ばらつき」は、性能ベンチマーク表では見えません。しかし本番では、障害復旧の速さ、監査対応のしやすさ、担当者交代時の引き継ぎやすさとして表面化します。だからこそ、推論基盤の標準化があらためて注目されます。

運用標準化が調達条件になると比較軸はどう変わるか

運用標準化が重視されると、製品比較の観点も変わります。以前は「精度が高いか」「レイテンシが低いか」が主役でしたが、今は「既存基盤にどう載るか」「複数モデルを同じルールで扱えるか」も同じくらい重要です。

具体的には、大企業や規制業種では、SLAを設計しやすいか、ロールバックしやすいか、監査ログを取りやすいか、アクセス制御を共通化できるか、といった条件が調達要件に入ることがあります。こうした観点は、情報システム部門やセキュリティ部門が深く関与する案件ほど重視されやすくなります。

この変化は、技術選定の失敗パターンも変えます。最先端モデルを導入しても、運用設計が複雑すぎてスケールできなければ、結果として投資対効果は下がります。逆に、十分に高性能で、しかも運用が揃えやすい基盤は、長期的に評価されやすくなります。

NIMは自前構成より標準化しやすく、完全マネージドAPIより環境を制御しやすい場面がある

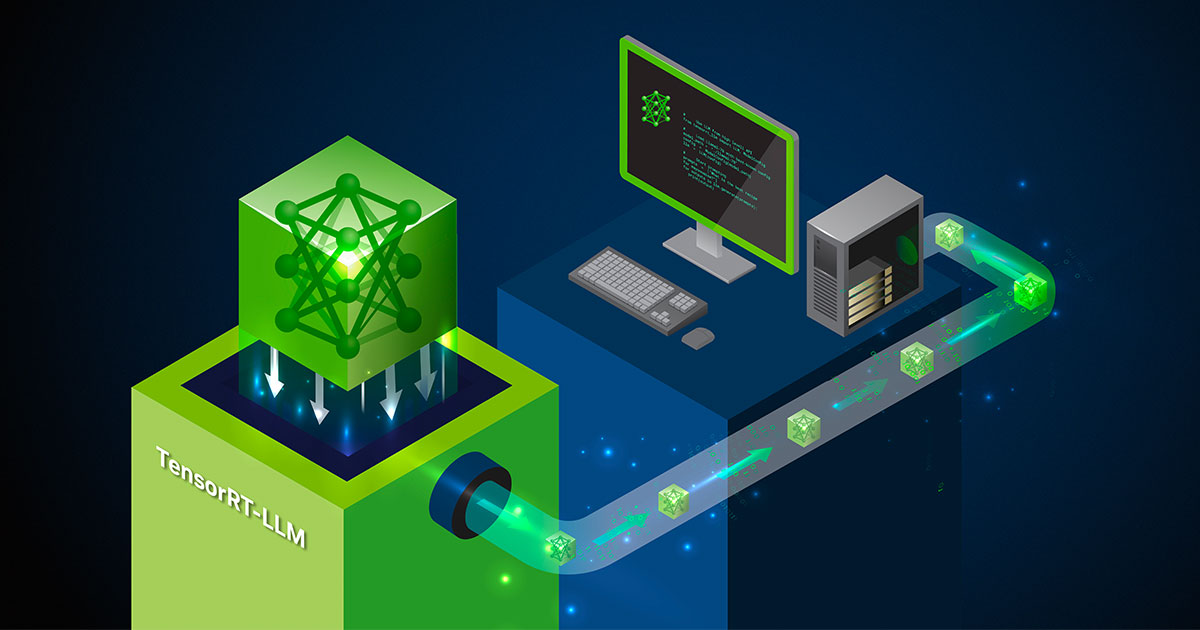

NIMの立ち位置を理解するには、OSS中心の自前構成に比べて標準化しやすく、完全マネージドAPI型サービスに比べて環境を制御しやすい場面がある、と捉えるとわかりやすいです。完全自前は自由度が高い一方で、最適化や保守の負荷が重くなります。完全マネージドは導入が速い一方で、環境制御やデータ配置に制約が出やすいです。

NIMは、NVIDIAのGPU最適化やエンタープライズ向け提供形態を活かしつつ、一定の標準化された方法でモデルを扱える点が特徴です。特に、GPU基盤を自社や専用環境で管理したい企業には、現実的な選択肢になりやすいでしょう。

もちろん、どれが常に最適とは言えません。小規模な検証ならAPIサービスが向く場合もありますし、高度な最適化が必要なら自前構成が有利なこともあります。重要なのは、自社の運用体制と調達条件に対して、どの選択肢が最も無理なく回るかです。

本番運用をイメージしやすい3つのケース

一つ目は、社内チャットボットです。人事、法務、営業で利用が広がると、利用者数が増えるだけでなく、回答品質の監視や権限管理も必要になります。このとき推論基盤が標準化されていると、部署ごとの差異を抑えながら展開しやすくなります。

二つ目は、社内文書検索です。RAGのように外部知識を組み合わせる仕組みでは、モデル本体だけでなく、検索、埋め込み、再ランキングなど複数要素が絡みます。こうした構成では、個別最適よりも運用ルールを揃えやすい基盤のほうが後から効いてきます。

三つ目は、業務アプリへの組み込みです。たとえば問い合わせ分類、レポート要約、FAQ自動生成のような機能は、一度動けば終わりではありません。バージョン更新、レイテンシ監視、障害切り分けが継続的に必要になるため、推論基盤の統一が効いてきます。

結局のところ、企業が買いたいのは単体の高性能モデルではなく、業務に組み込んでも崩れにくい仕組みです。この視点で見ると、NVIDIA NIMの価値は「最新だから」ではなく、「運用をそろえやすいから」に近いと言えます。

モデル性能より“回る基盤”が選定で重視されやすくなる

NVIDIA NIMと企業向け推論基盤が注目される背景には、一部の企業で生成AI活用の主戦場が実験から本番へ広がりつつあることがあります。いま問われているのは、モデル単体の強さだけではなく、配備、監視、更新、統制をどれだけ標準化できるかです。

企業にとっての推論基盤の評価軸は、これからさらに性能比較から運用標準化へ見直されていく可能性があります。AI基盤選定に関わるなら、ベンチマーク表だけでなく、運用の再現性と全社展開のしやすさまで含めて見ることが重要です。

派手ではありませんが、導入成否を分けるポイントはそこにあります。